Julen 2017

Ukebrevet Tirsdag morgen tar noen ukers kunstpause. Takk for at du følger bloggen og abonnerer på ukebrevet. Min lille gave til deg er et utvalg ukebrev jeg er litt ekstra godt fornøyd med. Håper du blir det også. Under er de beste ukebrevene fra 2017. Også tilgjengelig som PDF.

God jul, og gode nye tirsdager i 2018!

Hvordan 84% av norske virksomheter skaffer nye kunder

I Norge er det i 2024 ca 660.000 virksomheter (SSB). 550.000 av disse – 84 prosent – har færre enn 5 ansatte. Av disse er en overveldende majoritet uten registrerte ansatte. De er det vi kan kalle “soloprenører”.

En soloprenør er en person som driver sin virksomhet alene, uten andre ansatte. Begrepet er satt sammen av “solo” og “entreprenør”, og peker på rollen som både eier og eneste operative i virksomheten.

En soloprenørs største daglige glede er friheten: ingen sjefer, fleksibilitet, store muligheter til å utforme sin egen arbeidsdag, et jevnt og stødig tilfang av nye, villige kunder.

En soloprenørs største daglige frustrasjon er det samme: ingen sjefer – led deg selv! Så stor fleksibilitet at livet går ut av ledd. Skiturer i marka midt i arbeidsdagen – mens du grubler på hvordan du skal overleve neste måned. Kanskje noen nye kunder – bare du ikke så inderlig HATET å selge deg selv!

Soloprenøren er både vaktmester, visjonær og alt i mellom, inkludert salgs- og markedssjef.

Å selge seg selv

Og akkurat den rollen – som selger av seg selv – er det mange soloprenører som sliter med.

Fra april til juni er salg og markedsføring for soloprenører eller småbedriftseiere et gjennomgående tema i våre digitale nettverksmøter i Soloprenørnettverket PiT. Nettverket tilbyr soloprenører en møteplass for kunnskapsdeling, erfaringsutveksling, inspirasjon og læring.

Det første møtet har tema “Hvordan skaffe nye kunder?”

Møtet er åpent for alle (fordi vi gjerne vil ha flere medlemmer), mens de øvrige er kun for medlemmer av nettverket.

- Meld deg på nettmøtet onsdag 17. april kl 17 her (åpent for alle, men begrenset antall).

- Se møteplanen for de neste 12 månedene i Soloprenørnettverket PiT her

- Nysgjerrig på nettverket? Meld din uforpliktende interesse her, så tar vi kontakt

- Klar for innmelding? Gjør det her.

Hvordan skaffe nye kunder da?

Men hvordan skaffer man seg nye kunder da? Etter mer enn 40 år i små virksomheter, de fleste av dem som soloprenør, har jeg fremdeles ikke ett entydig svar på det. Suksess som soloprenør handler om mye av det samme som suksess i større virksomheter handler om: produkter eller tjenester noen er ute etter, synlighet, spesialisering, kvalitet, leveringsdyktighet,

Tidlig i min soloprenørkarriere brukte jeg ukebrevet du nå leser som et verktøy for å komme på radaren. (Les Å selge seg selv uten å selge). Det fungerte veldig, veldig bra – for fjorten år siden, men har ikke den samme effekten i dag. Det er vanskelig å få oppmerksomhet i det gedigne digitale universet der ute.

Derfor må man ta i bruk hardere skyts. Mange – meg med – opplever det som krevende å hele tiden poste på Linkedin, Facebook, Insta, Tiktok, arrangere frokostmøter, delta på frokostmøter, søkemotoroptimalisere, mingle og dingle med alle slags folk. Men det er slik spillet fungerer i dag. Spillereglene er gitt, selv om de stadig endres, og vil du være med på leken må du følge spillereglene.

I ukens nettmøte har jeg lyst til at vi skal gå gjennom noen av de mest effektive metodene i dag med fokus på hvordan det kan gjøres raskt, enkelt og effektivt – uten å sluke for mye mental kapasitet du gjerne vil ha til overs for kundene dine.

Det er som sagt åpent for alle denne gangen. Meld deg på, men kom i så fall med hele deg. Våre nettmøter handler om å dele kunnskap og erfaring, ikke bare sitte passivt og ta i mot.

God tirsdag – og vel møtt på onsdag.

PS. Jeg har sjefreflektert mye over dette temaet tidligere. Foruten “Å selge seg selv uten å selge” anbefaler jeg ubeskjedent den for oss soloprenører selvtillitsbyggende “Plant et frø og la naturen gå sin gang“.

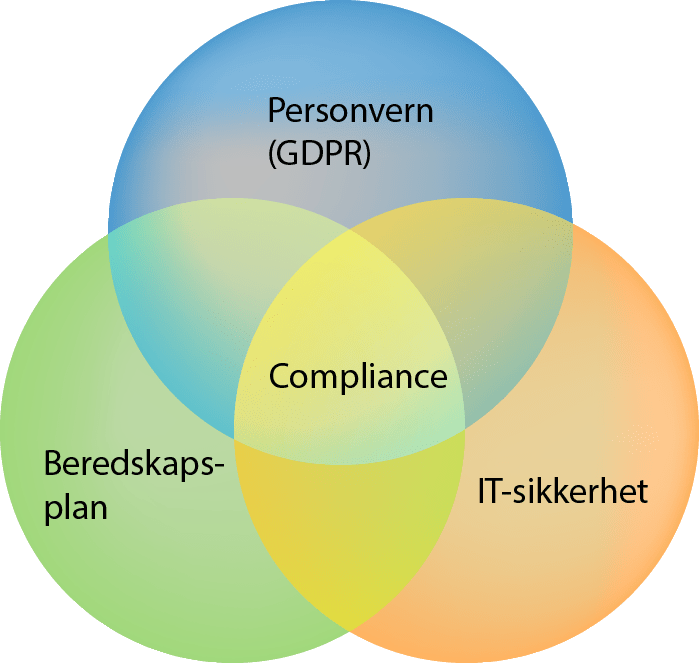

IT-jus nr. 3/24

Siden sist har jeg vært i retten med en svært prinsipiell sak – Grindr-saken. Saken handler dels om hvordan man innhenter samtykker, men også om det er en særlig kategori personopplysning at noen har en bruker på Grindr-appen. Det siste er nok det mest interessante.

Grindr-appen har ca 20 ulike kategorier av seksuelle orienteringer og dersom en bruker velger en av dem, deles ikke dette med andre. Det er svært uklart begrunnet i vedtaket fra Personvernnemnda om hvorfor og hvordan det at man har en bruker på Grindr, er sensitivt slik det er definert i GDPR. Jeg skal ikke ta argumentene her, men dersom dommen fastholder at dette er en særlig kategori opplysning, vil det ha stor betydning. Ikke bare for Grindr, men for mange andre virksomheter som retter seg mot minoriteter. Det vil bli vanskeligere å drive virksomhet rettet mot minoriteter – både for at all aktivitet må baseres på samtykke og for at kravene til sikkerhet gjør alt dyrere.

Saken viser noe som blir stadig tydeligere – nemlig at personvern påvirker forretningsmodeller og det griper inn i hvordan virksomheter kan konkurrere. Jeg tror vi får flere rettssaker fremover. Sakene er blitt for viktige til at man kan la et forvaltningsvedtak stå uprøvd. Noe av det som vil bli prøvd fremover, er hvor mye vekt man kan legge på retningslinjer fra EDPB når tilblivelsen av disse ikke har samme omfattende forberedelse som vanlige lover.

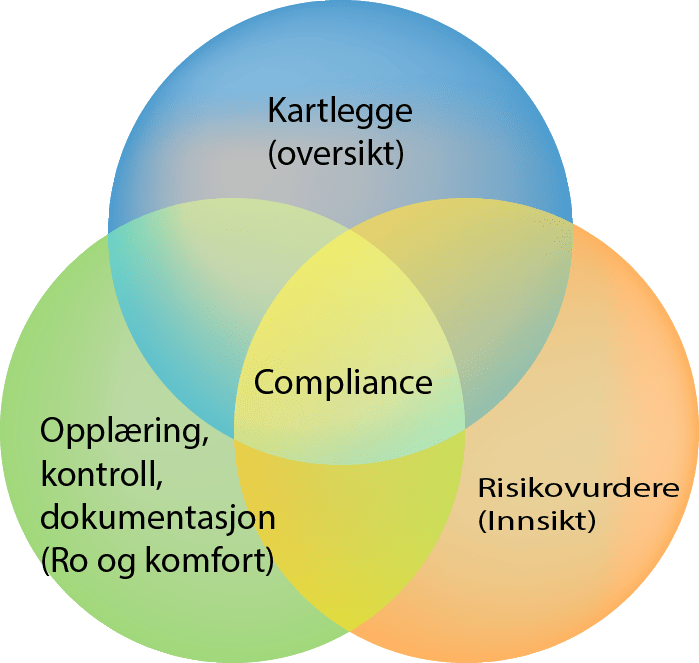

I øvrig er det selvsagt mye som skjer. Fokuset på etterlevelse (compliance) hos de store dataleverandørene er økende, se eksempelvis saken om Microsoft nedenfor. Cookies og markedsføring må vi ha stadig mer oppmerksomhet på. Felles behandlingsansvar er i vinden – og merk dere at det også gjelder for avvik.

Hilsen Eva

COMPLIANCE

En prinsipielt viktig sak – er Microsoft compliant?

Flere vil huske at det nederlandske datatilsynet har gjort undersøkelser har undersøkt hvorvidt Microsofts tjenester er i overensstemmelse med GDPR. Flere vil også huske at EDPS har gjort tilsvarende undersøkelser for de MS-tjenester som brukes i kommisjonen. Større deler av disse undersøkelsene er gjort offentlig tilgjengelige. Noen av hovedfunnene er at europeiske myndigheter mener Microsoft tar på seg en for stor rolle i behandlingen av en del av de brukeropplysningene som genereres under bruk, ofte referert til som metadata.

EDPS skriver følgende i sin nye pressemelding:

The EDPS has found that the Commission has infringed several provisions of Regulation (EU) 2018/1725, the EU’s data protection law for EU institutions, bodies, offices and agencies (EUIs), including those on transfers of personal data outside the EU/European Economic Area (EEA). In particular, the Commission has failed to provide appropriate safeguards to ensure that personal data transferred outside the EU/EEA are afforded an essentially equivalent level of protection as guaranteed in the EU/EEA. Furthermore, in its contract with Microsoft, the Commission did not sufficiently specify what types of personal data are to be collected and for which explicit and specified purposes when using Microsoft 365. The Commission’s infringements as data controller also relate to data processing, including transfers of personal data, carried out on its behalf.

Dette er store ord. Men vi har jo hørt lignende fra myndigheter i mange år uten at det egentlig har skjedd store endringer. Det kan se ut som om dette endres nå. EDPS pålegger kommisjonen å rette disse forholdene innen 9. desember 2024, hvis ikke må kommisjonen “suspend all data flows resulting from its use of Microsoft 365 to Microsoft [..]”.

Det er vel grunn til å tro at Microsoft ønsker å beholde kommisjonen som kunde – og det er mulig å tro at dersom kommisjonen får til endringer, så kanskje de vil gjelde for flere. Det er i alle fall all grunn til å følge med på dette fremover.

Pressemeldingen fra EDPS kom en stund før påske og er tilgjengelig her:

Her må man også se til hva det danske Datatilsynet gjør. I kjølvannet av den såkalte Chromebook-saken (overføring av personopplysninger til USA via Google), har de fått spørsmål fra Region Syddanmark om deres planlagte migrering til Microsoft 365. Det er neppe overraskende at tilsynet ser store fellestrekk mellom sakene. På et overordnet nivå må det være lov å si at det ofte brukes store ord fra tilsynsmyndighetene i disse sakene, men at det så langt er relativt sjelden at de strenge lovtolkningene håndheves.

Se uttalelse fra det danske tilsynet her

BØTER

Pass på hvilke data kundene dine kan se

CaixaBank fikk 5 millioner euro i bot som følge av et brudd på personvernregler i forbindelse med at en bankkunde kunne se overføringer gjort av en annen kunde. Boten er bestridt og CaixaBank har signalisert at de vil utfordre sanksjonen. Banken mener boten er uproporsjonal fordi det var en eksepsjonell omstendighet.

Etter hva jeg har funnet, omhandlet bruddet kun ett enkelt tilfelle der en kunde kunne se en annen kundes data knyttet til en overføring av penger. Vedkommende kunne se avsender og mottaker samt noe mer data knyttet til overføringen. Da er det mulig å forstå at banken mener sanksjonen er stor.

Saken er pt ikke offentliggjort på engelsk, men er omtalt her:

https://www.dataguidance.com/news/spain-aepd-fines-caixabank-5m-inadequate-security

Meld avvik i tide – og samarbeid med tilsynet

Den 24. april 2023 meldte et selskap avvik til det østerrikske datatilsynet. Den 6. mars var de utsatt for et ransomware-angrep og data ble kryptert. Det var uklart om data var stjålet, men lønnsinformasjon om 55 ansatte ble berørt. Det ble iverksatt tiltak for å avhjelpe datainnbruddet, inkludert å koble hele nettverket fra internett, reinstallere og sikre systemer, samt sikkert slette krypterte harddisker.

Tilsynet startet undersøkelser, men fikk mangelfull respons fra virksomheten. Dels svarte de ikke, dels gjentok de bare den første avviksmeldingen. Dette endte med at de fikk 5 900 euro i bot. Jeg tror egentlig ikke at mange norske virksomheter ville oppført seg slik, men det er et økt fokus på å melde avvik i tide og på å samarbeide med tilsynet.

Les om saken her:

https://gdprhub.eu/index.php?title=DSB_(Austria)_-_2023-0.603.142&mtc=today

Nettbutikker og kundedata

Det finske datatilsynet har kommet med sin hittil største bot. Verkkokaupa, som er en stor nettbutikk, fikk 856 000 euro i bot i mars, tett på ti millioner kroner. Årsaken var blant annet at de ikke hadde fastsatt lagringstid for kundedataene. De mente at det var nødvendig å beholde dataene lenge fordi en del av varene hadde lang bruksverdi og at det var nyttig å beholde opplysningene dersom kunden ville klage. Delvis argumenterte de med at det var parallellitet mellom kundeforholdets varighet og lagringstiden. Dels hevdet de at de slettet data knyttet til kunder som var inaktive – og definerte dette som kunder som ikke hadde vært innlogget på 6 år.

Ingen av disse argumentene ble hørt. Tilsynet er klare på at det må fastsettes oppbevaringstider. Dessuten hadde selskapet gjort det obligatorisk å opprette en kundekonto for å handle hos dem. Tilsynet mente, ikke overraskende, at det ikke er nødvendig å opprette en konto for å gjennomføre et kjøp.

I likhet med de fleste store personvernsaker, er den påklaget og er ikke endelig. Det er uansett grunn til å merke seg hva tilsynet har ment og justere egen praksis dersom den ikke er i tråd med dette. Jeg tror nok det er sannsynlig at tilsynets oppfatning her blir stående.

Saken er omtalt her:

Italias største bot så langt

Det italienske datatilsynet (Garante) har ilagt energiselskapet Enel Energia SpA en bot på 79 000 000 euro for ulovlig reklame.

Enel samlet inn lister med potensielle kunder fra fire andre selskaper og dette gjaldt adresser, telefonnumre, kundens bostedskommune, og kundens energileverandør.

Garante understreket blant annet at Enel Energia brøt GDPR ved å unnlate å utføre en tilstrekkelig risikovurdering av sitt kundesystem (CRM). I tillegg sikret de ikke at andre selskaper, som skaffet dem nye kontrakter, overholdt regelverket. Dette omfattet også at de nødvendige databehandleravtaler ikke hadde tilstrekkelig innhold.

På samme måte som Federal Trade Commission i USA (FTC) ofte pålegger selskaper å informere (se sak lenger nede i nyhetsbrevet), er Enel Energia pålagt å informere berørte individer om utfallet av saken og en rekke andre tiltak som skal bedre personvernet.

Hørte jeg noen si at de jobber med leverandørrevisjon?

Saken er omtalt mange steder, blant annet her:

https://www.dataguidance.com/news/italy-garante-fines-enel-energia-7910m-gdpr-violations

COOKIES

Cookies og samtykke

Saken er ikke helt ny, men fra slutten av fjoråret. Det franske datatilsynet bøtela Yahoo med ikke mindre enn 10 000 000 euro for ikke å ha samtykker til cookies på plass. CNIL vektla også at dersom en bruker ville trekke tilbake samtykket til cookies, ville vedkommende miste tilgangen til eposten. Det er igjen interessant å merke seg at one-stop-shop-mekanismen i GDPR her ikke får anvendelse fordi tilsynsmyndighetene viser til nasjonale ekom-regler.

Enn så lenge har disse tingene ikke vært i fokus i Norge, men vi får antakelig nye cookieregler om kort tid og da er det all grunn til å være varsom med hvordan cookies og trackere brukes.

Se saken omtalt på disse stedene:

https://www.cnil.fr/fr/cookies-la-cnil-sanctionne-yahoo-dune-amende-de-10-millions-deuros

https://gdprhub.eu/index.php?title=CNIL_(France)_-_SAN-2023-024&mtc=today

Mer om cookies fra det danske datatilsynet

I 2023 behandlet det danske Datatilsynet to saker om GulogGratis og JFM’s bruk av cookies for utarbeidelse av statistikk. Datatilsynet mente at utarbeidelse av statistikk ikke var en nødvendig del av tjenestetilbudet til virksomhetene. Virksomhetene har senere bedt om gjenopptakelse av sakene, og slik jeg forstår det er det argumentert med at de trenger statistikk for å kunne fortelle annonsører om det er relevant å kjøpe bannerannonser på hjemmesidene. Datatilsynet synes å mene at dette er et markedsføringsformål, som er noe annet enn ren statistikk. Hva som er statistikk og for hvilke formål, er ikke alltid enkelt. Likevel er det å forvente mer fokus på dette fra mange tilsyn fremover.

Sakene er omtalt her

TILSYN

Svar når (hvis) tilsynet spør!

I 2023 gjennomførte EDPB som kjent en koordinert undersøkelse av personvernombudenes stilling. Hellas deltok også og sendte ut spørreskjema til 31 ombud i offentlig sektor. Ett ombud svarte ikke. Det greske tilsynet sendte deretter spørreskjemaet på nytt, men ombudet svarte fremdeles ikke. Etter utløp av fristen forsøkte vedkommende å svare på undersøkelsen, men da var lenken deaktivert av tilsynet. Etter at ombudet kontaktet tilsynet, ble lenken reaktivert, men ombudet svarte igjen ikke i tide. Ombudet hevdet at årsaken til den forsinkede responsen var tekniske problemer med nettstedet der spørreskjemaet var plassert, som hindret innlevering selv etter flere forsøk. Tilsynet var ikke enig i dette og ila selskapet en bot på 5 000 euro.

Nytt koordinert tilsyn fra EU

Etter at EDPB i 2022-2023 har gjennomført tilsyn med personvernombudenes rolle, er det nå i 2024 fokus på hvordan virksomheter ivaretar de registrertes rett til innsyn.

Personlig tror jeg dette varierer ganske mye. Samtidig er det helt grunnleggende personvern at dette ivaretas på en god måte. Kan vi ikke spørre og få svar på hvordan våre personopplysninger faktisk brukes, er det vanskelig å håndheve noen rettigheter overhodet. Arbeider du i en virksomhet som får spørsmål om dette – sørg for å svare i tide.

Du kan lese mer om dette her:

https://www.edpb.europa.eu/news/news/2024/cef-2024-launch-coordinated-enforcement-right-access_en

GDPR OG ANSATTE

BYOD og 2-faktor

Fra Spania er det kommet en litt spesiell sak der en arbeidsgiver ikke kunne be om de ansattes private mobiltelefonnummer for å sikre bruk av 2-faktor autentisering ved bruk av hjemmekontor. Det synes som om saken har bakgrunn i at arbeidsgiver ikke har stillet mobiltelefon til rådighet for arbeidstakere, men basert seg på bruk av privat mobiltelefon.

I Norge vil de fleste arbeidsgivere stille mobiltelefon til rådighet og problemstillingen blir neppe aktuell. Men det er interessant at det settes så strenge grenser rundt hva en arbeidsgiver kan be om.

Saken er omtalt her:

https://gdprhub.eu/index.php?title=AN_-_SAN_487/2024&mtc=today

FELLES BEHANDLINGSANSVAR

Mer om reklame, TCF og felles behandlingsansvar

Mange av dere har hørt meg (og andre) snakke om IABs Transparency Consent Framework de siste to årene. Det er et rammeverk som er meget relevant for digital markedsføring. Spesielt er det viktig for de som er publisister (aviser, mediehus) – og for de som bruker deres forbrukerflater som annonseplattform.

Forrige måned kom ECJ med en ny avgjørelse om IAB og TCF. Avgjørelsen er sammensatt og komplisert, men den slår blant annet fast at informasjonsstrengen som viser at en forbruker har samtykket til et bestemt formål, er personopplysninger. Det er kanskje ikke så overraskende. Men dommen sier også at organisasjonen IAB Europe er felles behandlingsansvarlig med virksomheten som bruker rammeverket. Det betyr at det må inngås spesielle avtaler som angir hvilken aktør som har ansvar for hva.

Avgjørelsen finner du her:

https://curia.europa.eu/jcms/upload/docs/application/pdf/2024-03/cp240044en.pdf

Den er også omtalt mange steder, blant annet her (omfattende artikkel):

og her (kortere artikkel):

https://www.lexology.com/library/detail.aspx?g=d2c61d5c-daa2-446d-ba68-5626733af097

Enda mer felles behandlingsansvar – denne gangen for brudd

I en alvorlig sak fra Slovakia om drap på en journalist og hans forlovede, ble det gjort omfattende undersøkelser. Blant annet ble flere mobiltelefoner, som tilhørte en mistenkt, undersøkt. Undersøkelsene ble dels gjort av Europol, dels av slovakisk kriminaletterforskning. Meldingene på telefonene var sendt via krypterte tjenester, men Europol hadde klart å dekryptere (deler av) materialet. De sendte materialet til kriminaletterforskningen i Slovakia.

Senere publiserte media innhold fra mistenktes meldinger, blant annet intim kommunikasjon mellom vedkommende og hans kjæreste. Den mistenkte klaget til Europol på at informasjonen ble offentlig og krevde 100 000 euro som kompensasjon. Halvparten av beløpet krevde han fordi han mente at han urettmessig var blitt hevdet å ha tilhørt en “mafialiste”, den andre halvparten fordi intim samtale med kjæresten var blitt offentlig. Europol bestred at de hadde noe ansvar og mente at de ikke var felles behandlingsansvarlig med Slovakia.

EU-domstolen fastslo at det ikke er nødvendig å bestemme hvilken av disse to enhetene – Europol eller medlemsstaten – som var årsak til avviket. For at solidaransvar skal kunne oppstå, må den enkelte som er berørt kun vise at det i forbindelse med samarbeidet mellom Europol og den aktuelle medlemsstaten, er blitt utført ulovlig databehandling som har forårsaket skade for vedkommende. Denne uttalelsen er, etter min oppfatning, viktig. Det betyr at flere parter risikerer ansvar for skade som skjer hos en annen.

Angående lekkasjen av den såkalte ‘mafialisten’, fant EU-domstolen at den registrerte ikke hadde klart å vise at ‘mafialistene’ der hans navn angivelig var inkludert, var blitt utarbeidet og oppbevart av Europol. Erstatningen for å ha blitt angitt å stå på ‘mafialisten’ ble derfor ikke vurdert nærmere.

Europol ble ikke hørt med at de hadde implementert passende tekniske og organisatoriske tiltak for å beskytte personopplysninger. Domstolen bemerket at data av en slik intim karakter viser behovet for at beskyttelsen må sikres strengt. Siden det fant sted en uautorisert tilgang, utgjorde dette et tilstrekkelig alvorlig brudd. Uten at jeg har lest originalteksten på dette, fremstår dette som en ganske streng tolkning.

Dertil fastslo domstolen at Den europeiske union kan pådra seg ansvar, som følge av offentliggjøringen av den registrertes intime samtaler.

Resultatet var at Europol og den slovakiske republikken er solidarisk ansvarlige for den ulovlige databehandlingen som forårsaket at den registrerte led ikke-materiell skade.

Hva gjelder utmålingen, la domstolen vekt på at det kun var offentliggjort transkripsjoner av samtalen og ingen fotografier. For dette fikk vedkommende 2 000 euro i erstatning. Beløpet er ikke høyt.

Saken er omtalt her:

https://gdprhub.eu/index.php?title=CJEU_-_C%E2%80%91755/21_P_-_Ko%C4%8Dner_v_Europol&mtc=today

BEHANDLING AV PERSONOPPLYSNINGER

Er muntlig informasjon behandling av personopplysninger?

| ||||||||||||||||

FTC, the Federal Trade Commission, fatter hovedsaklig vedtak mot amerikanske selskaper. Men nå har de inngått forlik med et selskap med forbindelser til Tsjekkia.

Den 22. februar 2024 kunngjorde FTC at Avast Limited betaler 16,5 millioner dollar og FTC forbyr Avast å selge eller lisensiere personopplysninger til reklameformål. Dette er et resultat av anklager om at Avast og dets datterselskaper solgte slik informasjon til tredjeparter etter å ha lovet at produktene deres skulle beskytte forbrukerne mot sporingsaktiviteter på nettet.

Gjennom sitt tsjekkiske datterselskap, samlet de inn forbrukernes browserhistorikk, lagret dette på ubestemt tid og solgte det uten tilstrekkelig varsel og uten samtykke. FTC hevdet også at selskapet villedet brukere ved å hevde at programvaren ville beskytte forbrukernes personvern ved å blokkere tredjeparts sporing, og at all deling ville være i “anonym og aggregert form”. FTC hevdet at selskapet solgte dataene til over 100 tredjeparter.

Fremover skal Avast basere eventuelt salg av slike opplysninger på samtykke, de skal informere forbrukere hvis informasjon har blitt solgt og innføre et omfattende personvernprogram.

Saken er omtalt her:

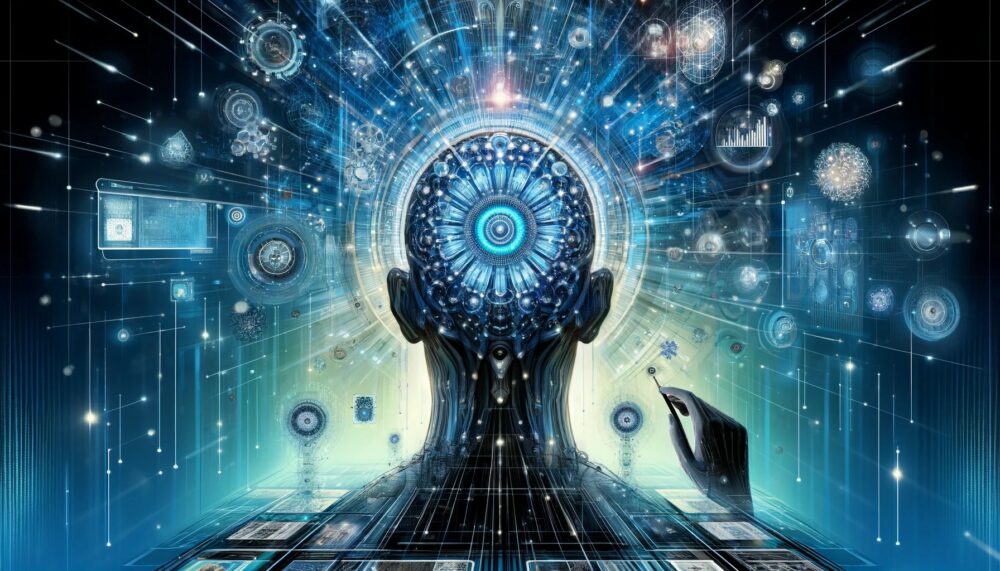

KUNSTIG INTELLIGENS

Kunstig intelligens og stemmegjenkjenning

| ||||||||||||||||

Bruk av lydopptak og KI kan generere mange ubehagelige situasjoner. Det er allerede kommet reportasjer om “fake calls” der man feilaktig blir lurt til å tro at et familiemedlem eller en sjef ber om en pengeoverføring. Det kommer til å gjøre noe med hvordan vi behandler lydopptak fremover. Et lite fransk selskap har som forretningside at stemmeopptak kan anonymiseres, eventuelt vannmerkes.

Vi kommer til å se mye ny teknologi fremover.

Les mere om KI og stemmebruk her:

PRIVATLIVETS FRED 😉

Til slutt – vil du at huset og nummerskiltet på bilen utenfor huset ditt skal være lett gjenkjennelig på Google maps?

Det er alltid morsomt å ta et streif for å skrive disse nyhetsbrevene. Jeg finner ofte mye spennende juss, men innimellom dukker det opp noe litt annet også.

Google maps er praktisk, men det er jo ikke sikkert at du vil at alle skal kunne se akkurat det som var utenfor ditt hus når google kjørte forbi. Eller hvem som sto i inngangspartiet. Her var det en artig liten artikkel om hvordan man kan få Google til å “blurre” bildet som er åpent for alle. Kanskje greit å sjekke hva Google maps har lagt ut av omgivelsene rundt ditt hus?

Les om hvordan du går frem her

KOMMENDE MØTER

| 25. april12.00 – 13.00 Digital Drop in |

| 23. mai14.00 – 17.00 Nettverksmøte i Oslo |

| 22. august14.00 – 17.00 Nettverksmøte i Oslo |

Se hele oversikten over kommende aktiviteter i nettverket her.

SISTE ORD

Du får dette nyhetsbrevet som medlem av tilt.works PrivacyTech-nettverk eller fordi du har tegnet et eget abonnement. Du kan oppdatere din profil her.

Diagnose: Kan brukes til alt

I en TED-talk fra noen år tilbake snakker Emilie Wapnick om multitalenter – eller multipotentials. Multitalentene er – og dette er min versjon, ikke Wapnicks – de blant oss som er bedre enn de fleste på det meste, men ikke så gode som de fremste ekspertene på noe.

Jeg kjenner selv noen sånne: Kompisen som veksler mellom å skrive skarpe kronikker, mekke motorsykkel, holde foredrag, lage gourmet-mat til hjemløse, guide toppleder-grupper mot smarte strategier, programmere komplekse systemer, diskutere vin som en sommelier, gå alene over Grønland, ta fantastiske naturbilder, og innimellom slagene rive ned og bygge opp det gamle huset fra bunnen av.

Tapt mulighet

I Wapnicks TED-foredrag er noe av poenget at dagens arbeidsliv ikke forstår verdien av multitalenter. Rekrutterere spør etter ekspertkompetanse, ikke bredde. De vil ha den beste kontrolleren, ikke en som er litt bedre enn gjennomsnittet, men også god på inbound marketing og treskjæring.

På den måten blir multitalentisme mer av en diagnose enn en styrke. Og det er synd, for i en verden hvor kunstige intelligenser inntar stadig flere ekspertområder, er et av de områdene som gjenstår evnen til å se hvordan ting henger sammen og gjennom det oppdage nye kombinasjoner.

Arbeidsgivere som ikke ser dette taper også muligheter.

I spagaten

For multitalentet innebærer det brede spennet av ferdigheter, som antagelig alle er knyttet til dyp interesse og lidenskap for de ulike områdene, at de blir stående i spagat. Vi vil gjerne ha folk vi kan putte i en bås, ikke folk som smetter fra den ene båsen til den andre; du vet aldri helt hvor de er eller hva du kan bruke dem til.

For konsulenter er kanskje dette en enda større utfordring. Måten du synliggjør din kompetanse for kunder er viktig. Selv driver jeg med coaching- og lederutvikling, men er også kjent blant mange som en habil PR- og kommunikasjonsperson, samt en som er ganske god på markedsføring, forretningsutvikling og HR. Jeg kan dessuten lage fine og avanserte nettsider, og har større praktisk innsikt i teknologi enn mange IT-folk.

I all beskjedenhet.

Det blir liksom ikke helt troverdig med en á là carte-meny på landingssiden som lar deg velge mellom tilsynelatende vidt forskjellige ferdigheter, som et universalverktøy fra en dubiøs nettbutikk.

Det er nok dette som gjør at jeg identifiserer meg så sterkt med coaching-kundene som kommer til meg og lurer på hva de skal bli når de blir store, til tross for at mange av dem er store nok allerede.

Talentgalleri

Det er kanskje det som er drivkraften som har gjort selskapet jeg med-gründet for fire år siden – tilt.work – til et fargerikt galleri av talenter som fra kundens ståsted åpenbart kan løse alle problemer, men i altfor liten grad får oppdrag.

Kunden har nemlig ikke alle problemer. Bare ett akkurat nå. Så leter de videre etter noen som fokuserer på dette ene.

Det er nok det som gjorde at jeg meldte meg frivillig til å ta med tilt.work til “dr. Nordskar”s idécafé. For deg som ikke har fått med deg den briljante reklame- og kommunikasjonsguruen Nils Petter Nordskar sitt siste sprell, så er det en løsningsorientert gratis rådgivningssamtale med små, ofte lett forvirrede, oppstartselskap.

Som oss i tilt.work.

Jeg skal i ilden i dag, tirsdag 9. april kl 12.00 for en 45 minutter lang samtale live, med mer enn 80 påmeldte og formodentlig aktive idé-innspillere.

Du er også invitert. Meld deg på her.

God tirsdag.

Emilie Wapnicks foredrag

Skal vi gni det inn, eller ikke?

Noen ganger opplever vi at mennesker vi er glade i, setter pris på eller av andre grunner er avhengig av å fungere sammen med, velger ord eller tar avgjørelser som bærer galt av sted.

Selv kan vi være en del av et utløsende samspill, eller vi har fått rollen som observatør. Uansett er det lov å kjenne på tanker som: «Var dette det lureste du kom på?» eller «Det ordvalget kunne du ha spart oss alle for.» Spørsmålet er om vi skal dele disse tankene, og i så fall hvordan?

read more…

Født som leder?

Setting: Venner og venners venners lag. Ved siden av meg en jeg ikke hadde møtt før. Vi snakket om løst og fast til tiden var moden for det obligatoriske «Hva jobber du med?».

Hun fortalte om et usedvanlig eventyrlig yrkesliv, og avdekket det jeg oppfattet som en imponerende, allsidig og reflektert personlighet.

Jeg fortalte at jeg utvikler ledere, og følte meg litt betydningsløs og grå i forhold.

Teknikk og håndverk

Derfor ble jeg overrasket da hun sa: «Ledelse kan ikke læres. Alle gode ledere jeg har hatt er folk som er født som ledere. De har det bare i seg, det er medfødt.»

Det var en påstand jeg ikke har hørt på ganske lenge, og jeg trodde kanskje vi var forbi dette stadiet. Jeg erklærte min uenighet:

«Ledelse er grunnleggende sett teknikk og håndverk. Teknikkene kan praktisk talt alle lære om de vil. Noen har helt sikkert et større talent for det enn andre, men uten trening blir du aldri en god leder, like lite som en Maradona blir fotballstjerne uten trening. Hvis det var slik at man enten er født med det eller ikke, kan jo en Maradona — født som fotballspiller — bare møte opp på banen?»

Hun var ikke overbevist.

«Det er ikke det samme», sa hun. «Ledelse er noe annet enn fotball.»

Jeg smilte stumt.

Mysteriet ledelse

Ledelse opphøyes ofte til noe mystisk, grensende til religiøst. Og store ledere kan virke som om de driver stor ledelse enkelt og naturlig og med den største selvfølgelighet. Men like lite som Maradona er guddommelig, er sjefen din det.

«Tro meg, ingenting kommer av seg selv. De lederne du har hatt som bare er ledere, inkludert de du hevder aldri har gått på lederkurs, har uten unntak brukt tusenvis av timer til å prøve, feile, reflektere, prøve igjen», forsøkte jeg meg videre.

Jeg tror kanskje hun var på gli.

Fra håndverk til kunsthåndverk

Ledelse er først og fremst et håndverk. Det kan læres. Talent, men først og fremst øvelse, kan gjøre en forskjell. Millioner av mennesker snekrer, bare et fåtall bygger hus. Millioner av mennesker kan skrive, bare et fåtall skriver bestselgende bøker. Millioner av mennesker kan male, bare noen få kan male taket i det sixtinske kapell eller en Mona Lisa.

Dedikasjon og talent kan opphøye nesten ethvert håndverk til et kunsthåndverk.

Ledelse inkludert.

De beste trener mer

Men det betyr ikke at millionene som maler, snekrer eller skriver ikke skaper verdi gjennom det de gjør.

Heller ikke at millionene som forsiktig prøver å forbedre sine lederferdigheter bare kan glemme det, for enten er de født med det eller så har de det ikke i seg.

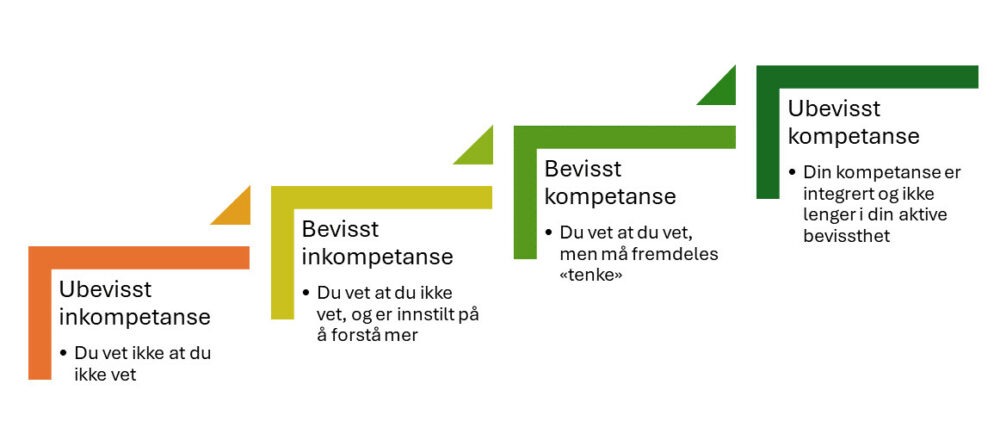

Enten man snakker om ledertrening eller annen kompetanseheving er det gjerne de som allerede er i utvikling som forstår at de trenger mer. De andre befinner seg på nederste trinn på læringstrappen:

Praktisk hverdagsledelse

Og selv om jeg som ledertrener gjerne skulle nådd fram til mennesker med de samme enten-eller-holdninger til ledelse som mitt nye bekjentskap, innser jeg at de som skal lære selv må innse at de trenger det. De må ha kommet forbi første trinn i læringstrappen.

I dette tilfellet handler læringen om praktisk hverdagsledelse. To kurs jeg holder er siktet inn mot dette området:

- Frivillig ledelse – rettet mot dyktige, dedikerte frivillige i de tusenvis av ideelle, frivillige eller nonprofit-organisasjoner Norge er så avhengig av – frivillige som kan mer enn de fleste om fagområdet de er ledere innenfor, men innser at ledelse er et eget fag som også krever trening. Les mer om Praktisk hverdagsledelse i ildsjeldrevne organisasjoner

- Prosjektledelse – rettet mot prosjektledere. De som deltar der kommer til å være meg uendelig overlegen på alt som har med administrasjon og styring av prosjekter. Likevel kan jeg sannsynligvis bidra mye hva gjelder teknikker og innsikt knyttet til å forstå og påvirke dynamikken i teamene de skal lede. Les mer om Coachende prosjektledelse og meld deg gjerne på vårt gratis digitale frokostmøte hvor dette kurset presenteres.

Det var dagens reklame.

Beklager, jeg er bare født sånn.

God tirsdag.

Les også: Liv og lære – et drama i fire akter

Bare 200 meter til: Små steg gjør store fremskritt

Jeg har gleden av å samarbeide med Ousland Explorers. Det er ingen som kan mer om ekspedisjoner enn dette selskapet. Men de er ikke bare et ekspedisjonsselskap, de driver like mye med opplæring.

read more…

Olivias verden

Vi ignorerte klimakrisen i mange tiår. Vi ignorerer fortsatt i all hovedsak den eksistensielle trusselen kunstig intelligens representerer. På tide å våkne?

Olivias verden

Jeg ble bestefar i sommer. Vesle Olivia nærmer seg åtte måneder.

I løpet av denne tiden har det vesle menneskebarnets hjerne og kropp utviklet seg i et vanvittig tempo.

Hvis man kunne se inni hodet hennes, ville de siste åtte månedene vært et sprakende fyrverkeri av nevroner som bygger et intrikat nettverk Internett fortsatt kan se med misunnelse på.

De første 25 år

Olivia kommer til å si sine første ord om noen måneder. I løpet av noen år vil hun lære å gå, løpe, sykle og gradvis utvikle sin evne til å fokusere, huske, koble, assosiere, tenke logisk, være empatisk, lære boklig kunnskap, forstå moralske, etiske og sosiale spørsmål.

Hun vil også utvikle sin egen selvbevissthet, opplevelsen av et «jeg».

Om 25 år eller så er hun kanskje ferdig med studiene.

Det pleide å være en grei utviklingsplan for et menneske.

Men det er er alt for sakte til å konkurrere med en annen relativt nyfødt skapning: Kunstig intelligens.

Olivias konkurrent

Hvis Olivia var en kunstig intelligens ville hun lest og sortert alt som er på internett, kunnet svare på all verdens spørsmål – flytende, og på hvilket som helst språk, og bestå enhver kunnskapstest vi er i stand til å tenke ut.

Før hun feiret sin første jul.

Dette får selv en teknologioptimist som meg til å grøsse.

Flater ikke ut

For ulikt Olivia og andre menneskebarns intellektuelle nivå, flater ikke den kunstige intelligensens rivende utvikling ut, i hvert fall ikke i noen fremtid vi kan overskue i dag.

Vi har det siste halvannet år, siden ChatGPT ble lansert, sett at kunstig intelligens har gått fra å være smarte papegøyer til å overgå mer enn 90 prosent av oss mennesker i kunnskapstester på de fleste utdanningsfelt.

Og teknologien skal utvikle seg i samme rivende fart i mer enn 24 år til før Olivia skal ut i arbeidsmarkedet.

Hva i alle dager skal Olivia gjøre som ikke allerede gjøres en million ganger bedre av KI?

Og – den unge jentas utfordringer i arbeidsmarkedet er antagelig en av de minste utfordringene vi vil møte.

Atomkrig, pandemi og KI

Debatten om kunstig intelligens har så langt vært preget av begeistring. Litt som når vi trener opp bikkjene våre og begeistret roper «se hva den kan!»

I bakgrunnen har vi hørt noen kritiske røster rope om at teknologien en dag vil bli superintelligent og overta jorden.

Vi har ikke greid å ta dem på alvor, like lite som vi har tatt klimakrisen på alvor.

Vi mennesker er skrudd sammen sånn: kriser er ferskvare. Globale katastrofer er stoff for science fiction-romaner og sære blogger.

Spørsmålet er nå om skiftet kunstig intelligens vil skape er kommet så nær i tid at det er på tide å få panikk.

Et voksende antall røster mer enn antyder det.

«Global prioritet»

I mai ifjor publiserte Center for AI Safety følgende uttalelse:

«Å redusere risikoen for utryddelse fra kunstig intelligens bør være en global prioritet sammenlignet med andre samfunnsmessige risikoer som pandemier og atomkrig.»

Uttalelsen ble signert av hundrevis av eksperter innen kunstig intelligens og andre fremtredende personer, inkludert: Sam Altman, administrerende direktør i OpenAI; Geoffrey Hinton, en av grunnleggerne av dyp læring; Stephen Hawking; Elon Musk; Nick Bostrom, forfatter av boken «Superintelligence»; og Bill Gates.

Tre eksistensielle trusler

Den svensk-amerikanske MIT-forskeren Max Tegmark er en av AI-dystopistene, og hans argumenter er ganske overbevisende.

En av de eksistensielle truslene han løfter frem er faren for at mennesker med onde hensikter bruker teknologien til å utvikle våpen, for eksempel i form av kjemiske eller biologiske stoffer som frembringer sykdom og død.

En annen er at KI utkonkurrerer oss i arbeidsmarkedet til de grader at det knapt er mennesker igjen.

En tredje, og den kanskje mest spektakulære (men troverdige) er at superintelligens vil være så mye smartere enn oss at den ser på mennesker som vi ser på amøber.

(Hint: Vi ser ikke på amøbene som våre herrer som skal adlydes, til tross for at vi skylder dem en viss takknemlighet som en tidlig versjon av oss i den evolusjonære linjen.)

Unngå irrelevans

KI er en fantastisk oppfinnelse. Som sci-fi-entusiast siden barndommen er mye av det som skjer i dag en drøm som er blitt virkelighet. Personlig bruker jeg KI-verktøy daglig. Jeg sparer masse tid på det, og opplever også at kvaliteten i verktøyene blir stadig bedre.

Det er jeg ikke den eneste som har oppdaget. Mange av jobbene våre er allerede i ferd med å bli helt eller delvis borte fordi bedriftseiere oppdager at det de betaler folk for å fylle tiden sin med kan gjøres på en brøkdel av tiden, med høyere kvalitet, og garantert uten sykemeldingsavbrudd.

For oss som ser nytten av dette i det daglige, blir det Max Tegmark og andre eksperter roper varsku om lett å avfeie som dystopiske dommedragsprofetier.

Hvis vi ønsker oss en meningsfull fremtid for våre barn og barnebarn, hvor det å være menneske fortsatt er relevant, tror jeg det er smart av oss å lytte til dem.

God tirsdag.

Foredrag

Denne artikkelen springer ut av refleksjoner knyttet til ulike foredrag jeg holder om kunstig intelligens. Skal jeg holde et slikt foredrag hos dere, eller skal vi bare ta en prat om KI? Ring, tekst eller send epost, så snakker vi om det.

Fordypning og kilder

- Center for AI Safety

- Future of Life om AI

- Max Tegmarks kåseri (som inspirerte metaforen med Olivia – takk for tips, Heidi Nygjelten!)

Darwin, dating og dommedag

Da jeg gikk ut av det forrige langvarige forholdet med en kvinne for noen år siden, etablerte jeg raskt en tilstedeværelse på et fenomen jeg hadde skulet litt misunnelig på i årene i et fast forhold: datingappene.

De utskjelte datingappene.

Jeg elsket dem.

For en fantastisk oppfinnelse!

Tusenvis av potensielle partnere, de fleste edru, samtlige per definisjon åpne for et forhold.

«Gamlemåten» – ut på byen på et tilfeldig utested – blekner hva gjelder både kvantitet og kvalitet.

Som et verktøy for å oppnå et definert mål er appene uovertrufne.

Velles perspektiv

Ikke alle er like begeistret.

Simen Velle tok til orde for å løfte menns tilgang til kvinner opp på den politiske dagsorden, med utgangspunkt i en påstand om at nettopp datingappene favoriserer et fåtall menn og etterlater resten i dyp frustrasjon og ensomhet.

Velle ble tolket som at han klandrer kvinnefrigjøringen for dette, noe han – sikkert klokelig – benektet fra en svært flat posisjon i dagene som fulgte.

Evolusjonens røst

Så kommer andre røster og sier at kanskje han ikke skulle lagt seg fullt så flat. Det er faktisk noe i dette, mener de.

For evolusjonen har favorisert kvinner som finner menn med høy posisjon, status og inntekt.

Kvinnekampen har gitt kvinner høyere posisjon, status og inntekt.

Men evolusjonen har ikke hengt med i svingene.

Derfor ser kvinner fremdeles etter menn med høyere status. Når kvinnens utsiktspunkt er blitt hevet, mens menn står ganske stille, blir det langt færre igjen.

Så det er ikke kvinnekampen som har skylda.

Ikke datingappene heller.

Darwin har skylda.

Eller naturens iboende treghet.

Stress og instinkt

Evolusjonen har latt oss overleve som art gjennom tusenvis av år ved å favorisere egenskaper som gir størst sjanse for overlevelse. Egenskaper som ikke nødvendigvis er hensiktsmessige i vår tid.

Stress for eksempel. Stress, frykt og de medfølgende biokjemiske prosesser er designet for å redde deg fra løver. Stress er ment å forbrukes i små porsjoner.

- Løve angriper,

- du flykter (eller blir spist),

- stress opphører.

I dag er løvene byttet ut med dårlige sjefer, ubrukelige kolleger, gretne kunder. Og de lusker ikke bort med halen mellom beina etter at angrepet er avverget. De er der hele tiden. Stresset blir en konstant faktor som spiser deg opp fra innsiden.

Frykten for utstøtelse

En annen egenskap som kanskje har utspilt sin rolle levde Simen Velle selv ut da han stod frem på TikTok med sitt kontroversielle budskap: vår trang til å bli sett, hørt og høre til.

Mennesket er isolert sett et relativt svakt lite dyr. Det sliter med å greie seg alene, men er fantastisk i flokk.

Å bli utstøtt fra stammen på savannen i Afrika var derfor gjerne ensbetydende med en dødsdom.

Å bli utstøtt fra venneflokken, avvist av en potensiell partner eller få bare to likerklikk på din sosiale post er ingen dødsdom.

Men naturens iboende treghet gjør at vi fremdeles reagerer som om det var det.

Nullstille instinkter?

Vi har i det hele tatt store utfordringer knyttet til naturens iboende treghet, og jeg synes vi må ta oss sammen og gjøre noe med det.

Skulle noe løftes opp på den politiske dagsorden, må det være hvordan vi skal nullstille gamle instinkter som ikke lenger passer til hvordan vi lever våre liv, og erstatte dem med nye, mer hensiktsmessige instinkter.

Spøkefullt? Ja, men med et snev av sannhet i.

De samme gamle instinktene som gjør at marginaliserte grupper angriper de som oppleves som bedre stilt er bakenforliggende i dagens urolige verden.

- En ung mann opplever seg selv som så utenfor alt at han bestemmer seg for å dø og ta med seg så mange av sine medelever på skolen som mulig.

- En politisk organisasjon er så forbitret at de vil drepe så mange som mulig av “de andre”, og er villige til å ofre sin egen befolkning i forsøket.

- En atommakt truer verden med total utslettelse heller enn å gi opp sin kamp mot vestlige verdier.

Oppgradert forstand

I alle disse historiene ser vi sporene av gamle instinkter fra savannen.

Forskjellen er våpnene og verktøyene de marginaliserte og deres motparter har tilgang på.

Evolusjonen har gitt oss teknologi, fremskritt, en slags “sivilisasjon”.

Men den har ikke oppgradert vår forstand.

Det er ikke bærekraftig.

God tirsdag.

PS. Etterskuddsvis gratulasjon med kvinnedagen!

IT-jus nr. 2/24

Ønsker dere alle en flott måned i mars – våren er endelig her!

Et stort og aktuelt tema på personvernscenen nå er EDPBs mening om Metas nye “pay or OK”-modell. Etter en avgjørelse fra ECJ i fjor, endret Meta hjemmelsgrunnlaget sitt for målrettet annonsering. Brukeren må nå samtykke til slik annonsering eller betale for å slippe.

Spørsmålet som da oppstår er: Kan Meta gjøre dette? Kan de kreve betaling? Alternativet ser ut å være at Meta tvinges til å tilby tjenester gratis og uten å kunne tjene penger på målrettet annonsering.

Eller kan man si at beløpet Meta krever er for høyt? Skal eventuelt store selskaper pålegges andre krav til gratis tjenester enn SMB-bedrifter? Eller skal man regulere hvilken pris de kan ta? Og – hva er i tilfelle et “stort selskap”? Det er en lang rekke spørsmål som oppstår her og de gjelder ikke bare Meta, men også for mange andre selskaper.

Jeg tror disse spørsmålene er svært viktige og min primære bekymring er at EDPB bare har åtte uker, med en mulig forlengelse på seks uker, til å skrive sin mening. Denne tidslinjen er fastsatt av bestemte artikler i GDPR, men disse gir en skremmende kort tidsfrist for å håndtere grunnleggende spørsmål om hvordan bedrifter kan sikre at de finansierer sine tjenester.

Se saken kommentert her

og her

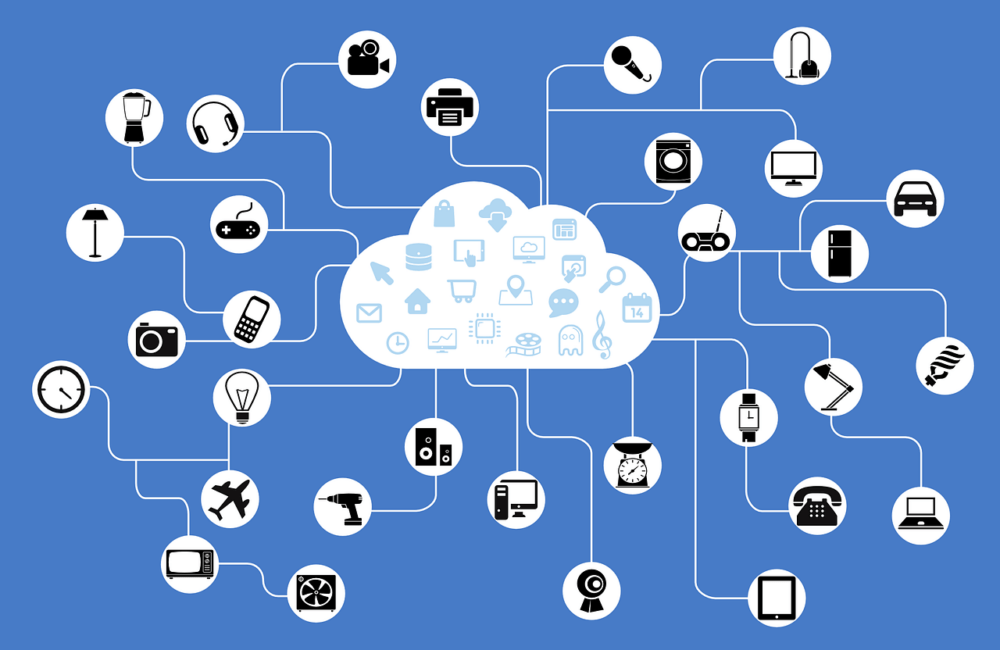

På andre områder sirkulerer mye av fokuset i personvern- og teknologiområdet fortsatt rundt AI. Siste status for AI Act er beskrevet nedenfor. Det er også en interessant sak fra Danmark knyttet til mangel på tilsyn av databehandlere – sannsynligvis viktig for mange. Et annet interessant tilfelle er fortsettelsen av Google ChromeBook i Danmark – men med en ny vri. Det er ikke lenger den internasjonale overføringen og dokumentasjon som er i fokus, men kontrollering av data.

Som alltid – god lesning!

Hilsen Eva

KUNSTIG INTELLIGENS

Status for AI-ACT

Endelig har EUs medlemsland oppnådd enstemmig enighet om en lov om kunstig intelligens, og med det overvunnet siste øyeblikks frykt for at regelboken ville kvele europeisk innovasjon.

Etter å ha blitt enige om grunnleggende prinsipper før jul, men uten å ha en presis lovtekst å vise til, har vi nå endelig fått en samordnet lovtekst for den kommende AI Act. Teksten er fortsatt et utkast som stadig gjennomgår språklige tilpasninger. Lovteksten vil mest sannsynlig passere Rådet og Parlamentet i ukene eller månedene som kommer, og forventes å bli publisert i Official Journal i mai / juni. Etter å ha blitt publisert der vil noen av artiklene tre i kraft etter kun seks måneder – dette gjelder for forbudt AI. For generativ AI trer artiklene i kraft etter 12 måneder. For høyrisiko AI som definert i vedlegg III, trer artiklene i kraft etter 24 måneder. For høyrisiko AI som definert i vedlegg II, trer de i kraft etter 36 måneder.

Noe som fanget min interesse, er at flere av artiklene i det nye utkastet er vesentlig forskjellig fra utkastene før jul. Blant de mer interessante endringene er at bøtene senkes. Ikke vesentlig, men betydelig. Jeg vil komme tilbake med en mer grundig analyse av den nye ordlyden. Fra det jeg hører, er det ikke forventet ytterligere endringer fremover, det er en språklig opprydding de gjør nå. Det nye utkastet er tilgjengelig på nett.

Se andres kommentarer på utkastet her

https://iapp.org/news/a/a-view-from-brussels-all-eyes-on-eu-ai-act/

og her

https://www.politico.eu/article/eu-countries-strike-deal-ai-law-act-technology/

Italiensk datatilsyn sier at ChatGPT bryter personvernreglene

Det i talienske datatilsynet har gitt OpenAI beskjed om at chatbot-applikasjonen ChatGPT bryter personvernreglene. Tjenesten ble reaktivert etter at OpenAI adresserte og rettet opp tidligere bekymringer fra det italienske datatilsynet, blant annet knyttet til brukerens rett til å nekte samtykke til bruk av personopplysninger for trening av algoritmer. Uten å gi ytterligere detaljer, har det italienske datatilsynet nå konkludert med at visse elementer ved tjenesten indikerer ett eller flere mulige personvernbrudd. Vi vet per nå ikke hva disse elementene er.

Open AI har på sin side uttalt at de mener at praksisen er i tråd med EUs personvernregelverk, og har 30 dager på seg til å fremsette sine motargumenter.

Italia var det første vesteuropeiske landet som bremset ChatGPT, hvis raske utvikling har tiltrukket seg oppmerksomhet fra lovgivere og regulatorer. Det er synd at ikke mer informasjon om denne saken er kjent, da lovligheten av AI-systemer er et spesielt hett tema. Men jeg er sikker på at vi vil vite mer om dette tilfellet om ikke så lenge.

Les mer her

Bruk av AI – er våre “søk” lagret?

Ikke skriv noe inn i Gemini, Googles familie av GenAI-apper, som er inkriminerende – eller som du ikke vil at noen andre skal se. I et støttedokument skisserer Google hvordan de samler inn data fra brukere av sine Gemini chatbot-apper for internett, Android og iOS. Google bemerker at brukere rutinemessig behandler samtaler med Gemini for å forbedre tjenesten. Disse samtalene lagres i opptil tre år sammen med “relaterte data”, som språkene og enhetene brukeren brukte og deres plassering. Brukeren kan imidlertid slå av Gemini Apps-aktivitet i Googles My Activity-dashbord, dette forhindrer fremtidige samtaler med Gemini fra å bli lagret i en Google-konto for gjennomgang.

Men selv når Gemini Apps-aktivitet er slått av, vil Gemini-samtaler bli lagret på en Google-konto i opptil 72 timer for å “opprettholde sikkerheten til Gemini-apper og forbedre Gemini-apper.”

Googles GenAI-retningslinjer for datainnsamling og oppbevaring skiller seg ikke så mye fra konkurrentenes. OpenAI lagrer for eksempel alle chatter med ChatGPT i 30 dager uavhengig av om ChatGPTs samtalehistorikkfunksjon er slått av, bortsett fra i tilfeller der brukeren abonnerer på en “enterprise-level plan” med en tilpasset dataoppbevaringspolicy. Etter hvert som GenAI-verktøy sprer seg, blir virksomhetene stadig mer oppmerksomme på personvernrisikoen.

OpenAI, Microsoft, Amazon, Google og andre tilbyr GenAI-produkter rettet mot bedrifter som eksplisitt ikke beholder data i lengre tid, verken for modellopplæring eller andre formål. Men forbrukerne får – slik som ofte er tilfelle – den dårligste dealen.

DATABEHANDLERE

Straff for manglende gjennomføring av leverandørtilsyn

Det danske datatilsynet har anmeldt en part for ikke å ha ført tilsyn med sine databehandlere.

Datatilsynets etterforskning av parten viste at de ikke hadde overvåket sine databehandlere. Det første tilsynet ble utført da Datatilsynet begynte sine undersøkelser. Datatilsynet fant at parten ikke opptrådte i samsvar med kravene til ansvarlighet. De understreket at det ikke hadde blitt ført tilsyn med databehandlerne over flere år og at behandlingen innebar et stort antall registrerte personer. I tillegg ble sensitive personopplysninger behandlet.

Tilsyn knyttet bruken av databehandlere har blitt stadig vanligere de siste årene. Slik var det ikke i 2018, men det er en naturlig utvikling.

I tillegg til politianmeldelse, ble det anbefalt en bot på ikke mindre enn DKK 1 500 000. Så vidt jeg vet, er dette den første avgjørelsen hvor en part blir bøtelagt for ikke å ha gjennomført tilsyn med sine databehandlere.

Har du i det hele tatt sendt noen spørsmål til prosessorene dine? Hvis ikke er det på tide å begynne med det. Det finnes maler for hvilke spørsmål man bør stille.

Les mer her:

GOOGLE OG DE DANSKE SKOLENE

Historien om Chromebooks i danske skoler var ikke over

Den 30. januar kom det danske datatilsynet opp med en oppsiktsvekkende beslutning om bruk av Google Chromebooks og Workspace for utdanning i skoler. Beslutningen konkluderer med at behandlingen av personopplysninger i visse deler av tjenestene er ulovlig, da det ikke finnes noe rettslig grunnlag i personvernforordningen og nasjonal lovgivning for delingen av informasjon med Google. Her kan det være grunn til å minne om at hvert enkelt ledd i en behandlingsaktivitet, og deling av opplysninger, må ha en hjemmel. Både utlevering av informasjon – og mottak av informasjon.

Derfor utstedte Datatilsynet et pålegg til 53 danske kommuner om å bringe behandlingen i tråd med reglene og sikre at alle personopplysninger som behandles i Googles tjenester har et tilstrekkelig rettslig grunnlag.

Kommunene oppgir i det innsendte materialet at det er en overføring av personopplysninger til Google som Google bruker til egne formål. Ikke for skolenes formål. Formålet for Google sies å være forbedring av deres tjenester og utvikling av nye tjenester. Poenget til datatilsynet er imidlertid at skolene må ha et rettslig grunnlag for å gi studentenes personopplysninger til Google for slike formål – og at de ikke kan se at slikt rettslig grunnlag foreligger.

Dette er en situasjon som er svært vanlig, ikke bare for skoler. Man kan forestille seg nøyaktig den samme problemstillingen i ansettelsessituasjoner. Hva er det juridiske grunnlaget for at våre arbeidsgivere skal gi våre personopplysninger til leverandører av IT-tjenester?

Jeg tror vi vil se den samme diskusjonen på dette området om ikke lenge. Det snakkes om det nedover i Europa. Dette er også ganske parallelt med tidligere undersøkelser fra EDPS om hvordan Microsoft behandler informasjon om brukerne av deres produkter, noe jeg har adressert i dette nyhetsbrevet tidligere.

Det danske datatilsynet har beordret kommunene til å bringe behandlingen i tråd med reglene ved å sikre at det foreligger autorisasjon for all behandling som finner sted. Kommunene må overholde pålegget fra 1. august 2024, men må angi hvordan de skal innrette seg allerede 1. mars.

Se også hvordan det norske Datatilsynet kommenterer saken, i lenken under. Det ser ut til at de tror den samme situasjonen kan gjelde i Norge, men at de ikke har gjennomført en nærmere vurdering av dette. Noe å tenke på for flere, her. https://www.personvernbloggen.no/2024/02/15/hva-betyr-den-danske-chromebook-saken-for-norge/

FORBRUKERE, INNSYN OG RETT TIL ENDRING

Straff for ulovlig å be om for mye informasjon

Vi har snakket om det mange ganger – du må være sikker på at du gir informasjon til riktig person, men du kan ikke be om mer identifiserende informasjon enn nødvendig.

Dette vises av en sak som behandles av datatilsynet i Hellas. De irettesatte en behandlingsansvarlig for ulovlig å spørre om en registrerts ID når de svarte på en tilgangsforespørsel, og for å ikke i tilstrekkelig grad informere brukerne om et databrudd.

I denne saken ba en registrert om en kopi av sine personopplysninger i henhold til artikkel 15(3) GDPR etter å ha blitt informert av media om at den behandlingsansvarlige hadde hatt et databrudd. Den behandlingsansvarlige drev et nettsted. Den registrerte nektet for noensinne å ha opprette en konto på nettstedet og hevdet at noen andre måtte ha gjort dette ved hjelp av vedkommendes e-postadresse.

Den behandlingsansvarlige svarte at de eneste dataene de behandlet var den registrertes IP-adresse og brukernavn som ble innhentet ved registrering, og at den registrerte måtte oppgi en ID for at den behandlingsansvarlige skulle kunne identifisere ham og gjennomføre tilgangsforespørselen. Den registrerte svarte at ID-en ikke var nødvendig fordi han brukte e-postadressen sin – og klaget til tilsynet. Nettstedet uttalte at de krevde en ID i forbindelse med tilgangsforespørsler for å kunne beskytte brukere mot uautoriserte utleveringer, og at dette er i tråd med punkt fortalepunkt 64 i GDPR.

Datatilsynet mente derimot at den behandlingsansvarlige handlet i strid med artikkel 5(1)(c) GDPR ved å samle inn ID-er utelukkende for å overholde de registrertes tilgangsforespørsler, fordi dette var overdrevent.

Det er ikke alltid lett å vurdere hvilket nivå av sikkerhet som kreves for utlevering av informasjon, men som en generell regel bør det være tilstrekkelig å bruke e-posten som den behandlingsansvarlige har tilgjengelig.

https://gdprhub.eu/index.php?title=Commissioner_(Cyprus)_-_11.17.001.010.007&mtc=today

Tekniske rammeverk ignoreres – Klarna AB

Det svenske datatilsynet (IMY) startet tilsyn med Klarna Bank AB («Klarna») på grunn av en klage fra en tysk statsborger. Klageren har et Klarna-kort og har bedt om korrigering av e-postadressen knyttet til kortet. Klarna sier at det ikke er teknisk mulig å endre e-postadressen knyttet til klagerens kort og at klager derfor må bestille et nytt kort for å få endret e-postadressen sin. Et nytt Klarna-kort vil imidlertid påvirke klagerens kredittverdighet og vedkommende ønsker ikke det.

IMY skriver at saken viser at Klarna har behandlet personopplysninger i strid med artikkel 12.2 i GDPR ved ikke å ha lagt til rette for klagerens rett til retting – ved å ikke gjøre det mulig for klageren å endre sin e-postadresse. Å ikke korrigere e-postadresse, anses som et brudd på artikkel 16.

Her ser vi at IMY motsetter seg hvordan Klarna har satt opp sin interne logistikk. Jeg tror dette er en trend – at det å håndheve GDPR faktisk også innebærer innvendinger om hvordan bedrifter (og noen ganger forretningsmodeller) er satt opp. Ikke alle er positive til at myndighetene blander seg inn i slikt, men det er i noen tilfeller en naturlig konsekvens av hvordan GDPR fungerer.

https://www.imy.se/globalassets/dokument/beslut/2024/beslut-klarna-bank-imy-2023-8336.pdf

Personvern i biler

En forbrukergruppe har funnet ut at «Tilkoblede tjenester»-funksjonen som er innebygd i nye Toyota-biler kan sende personopplysninger og kjøretøydata til tredjeparter. Hvis sjåførene fjerner komponenter som sender dataene, risikerer de at bilens garanti blir annullert.

Toyota har insistert på at det tar kundenes personvern «ekstremt alvorlig», men har erkjent at «Tilkoblede tjenester»-funksjonen bare kan deaktiveres, men ikke fjernes, fra bilene. Ellers kan sjåfører ugyldiggjøre garantien og gjøre Bluetooth og høyttalere ikke-funksjonelle.

Det har blitt avdekket at Toyotas “Tilkoblede tjenester”-funksjon samler inn informasjon som kjøretøyets plassering, kjøredata, drivstoffnivåer og til og med telefonnumre og e-postadresser. Hvis du ikke melder deg av tjenesten, vil den samle inn og bruke person- og kjøretøydata for forskning, produktutvikling og dataanalyseformål. Tjenestene kan også under noen omstendigheter dele dataene med tredjeparter, for eksempel forsikringsselskaper.

Jeg tror at personvern i biler ennå ikke har fanget lovgivernes oppmerksomhet på ordentlig. Men med tanke på at lokasjonsdata får stor oppmersomhet i andre personvernspørsmål, tror jeg at dette vil komme ganske snart.

Fortsatt hardt vær for Facebook

Den nederlandske regjeringen vurderer å trekke seg helt fra Facebook på grunn av alvorlige bekymringer om hvordan den sosiale medieplattformen håndterer datasikkerhet. Regjeringen har i flere år vært bekymret for hvordan Facebook håndterer personvernsensitive data, og den nederlandske regjeringen har ved gjennomføringen av en DPIA avslørt det de mener er alvorlige mangler. De har visstnok diskutert dette med Meta, men Meta har ikke gjennomført tilfredsstillende forpliktelser eller forbedringer. Meta er tilsynelatende ikke enig i funnene i DPIA.

I november spurte den nederlandske regjeringen det nederlandske datatilsynet om det er trygt å fortsette å bruke Facebook. Tilbakemeldingen fra datatilsynet er forventet å være klar snart. Imidlertid synes den foreløpige indikasjonen å være at regjeringen forventer å slutte å bruke Facebook og at de allerede gjør forberedelser for dette.

https://nltimes.nl/2024/02/05/dutch-government-considering-ditching-facebook

GDPR OG ANSATTE

Overvåkning av ansatte

Den 27. desember 2023 bøtela det franske datatilsynet (CNIL) Amazon France Logistique 32 millioner euro for å ha satt opp et overdrevent påtrengende system for overvåking av ansattes aktivitet. Selskapet ble også bøtelagt for videoovervåkning uten informasjon eller tilstrekkelig sikkerhet.

Selskapet administrerer Amazon-konsernets lager i Frankrike, hvorfra de sender pakker til kunder. Hver lageransatt får en skanner for å dokumentere hvordan arbeidet utføres i sanntid. Hver skanning registreres og brukes til å beregne informasjon om kvaliteten, produktiviteten og perioder med inaktivitet for hver ansatt.

CNIL vurderte at systemet for overvåking av ansatte var overdrevent. CNIL fastslo bl.a. at det var ulovlig å sette opp et system som måler arbeidsavbrudd med slik nøyaktighet, noe som potensielt krever at ansatte må rettferdiggjøre hver pause eller avbrudd. Videre kom CNIL til at systemet for måling av hastigheten pakker ble skannet med var overdrevent. CNIL anså det også som overdrevent å beholde alle dataene som samles inn via systemet, samt de resulterende statistiske indikatorene, for alle ansatte og midlertidige arbeidere, i en periode på 31 dager.

Ved fastsettelsen av botens størrelse ble det spesielt tatt hensyn til det faktum at analysen/overvåkingen var forskjellig fra tradisjonelle aktivitetsovervåkingsmetoder – særlig hva gjelder innhold og varighet, og at overføringen førte til svært tett og detaljert overvåking av ansattes arbeid.

Nå tror jeg ikke at mange norske virksomheter vil innføre denne type overvåking av ansatte, men det er klart at i et globalt marked er det en viss “smitteeffekt” fra land der slike systemer tillates.

Saken er omtalt her:

https://www.cnil.fr/en/employee-monitoring-cnil-fined-amazon-france-logistique-eu32-million

Uber beskytter ikke sjåførenes personvern – får en stor bot i Nederland

Det nederlandske datatilsynet har bøtelagt Uber 10 millioner euro for brudd på personvernregelverket i relasjon til sjåførenes personopplysninger.

Tilsynet kom til at Uber ikke hadde spesifisert hvor lenge de beholdt sjåførenes personopplysninger, eller hvordan de sikret personopplysninger når disse ble sendt til enheter i land, som de ikke hadde navngitt, utenfor EØS.

Uber hindret også sjåførenes mulighet til å utøve sin rett til personvern ved å gjøre forespørsler om tilgang til personopplysninger unødvendig komplisert.

Boten ble ilagt etter at over 170 franske sjåfører klaget Uber inn til en fransk menneskerettighetsorganisasjon, som sendte inn en klage til det franske datatilsynet. Siden Uber har sitt europeiske hovedkvarter i Nederland, ble klagen videresendt til det nederlandske datatilsynet.

HOVEDETABLEING + NOYB

EDPB klargjør begrepet om hovedetablering (“Main establishment”)

EDPB har gitt en uttalelse om begrepet hovedetablering og kriteriene for anvendelsen av One-Stop-Shop-mekanismen (OSS). De skriver følgende hovedpunkter:

- For at OSS skal gjelde, må etablering av den behandlingsansvarlige innenfor EU ta beslutninger om formålene og metodene for behandling.

- Hvis beslutninger om formålene og metodene – og makten til å få dem implementert – utøves utenfor EU, vil OSS ikke gjelde.

- Bevisbyrden faller på den behandlingsansvarlige – ting som plassering av regionale hovedkontorer og hvor retningslinjer for personvern fastsettes er «relevante elementer», men ikke avgjørende, og datatilsynet kan realiteten i dette.

- Uttalelsen advarer spesielt om at GDPR ikke tillater «forumshopping» i identifiseringen av hovedetablering.

Denne uttalelsen er den siste i en rekke konkrete tiltak tatt av EDPB etter Wien-erklæringen om grenseoverskridende håndhevelse, med sikte på å effektivisere håndhevelse og samarbeid mellom datatilsynene.

NOYB har undersøkt personverntilstanden i Europa

I november 2023 gjennomførte NOYB en nettbasert undersøkelse for å få innsikt i den praktiske implementeringen av GDPR. Noen vil kanskje si at funn fra NOYB sannsynligvis vil vippes til å være for personvernfokusert, men rapporten er faktisk en ganske god analyse av hva som er oppnådd med GDPR og hva som er nåværende status for etterlevelse av reglene.

Undersøkelsen inkluderte blant annet spørsmål om selskapers etterlevelse av GDPR, om vanskeligheten med å overbevise andre avdelinger eller ansatte i et selskap om etterlevelse av GDPR og spørsmål om de mest relevante faktorene som påvirker etterlevelsen av GDPR. Undersøkelsen fokuserte på personvernombud og andre som jobber med etterlevelse.

Rapporten belyser et utbredt problem om manglende etterlevelse på tvers av ulike sektorer. Mange unnlater å beskytte enkeltpersoners personvernrettigheter og å sikre personopplysninger i samsvar med GDPR.

Videre fant de mangel på åpenhet og ansvarlighet i databehandlingspraksis, med organisasjoner som ofte ikke klarer å gi klar og tilgjengelig informasjon om deres retningslinjer for datainnsamling, lagring og bruk. De fant også at mange organisasjoner mangler robuste sikkerhetstiltak for å beskytte mot databrudd og uautorisert tilgang. Dette setter enkeltpersoners personopplysninger i fare for utnyttelse og misbruk.

NOYB fant også at samtykkehåndteringsprosesser ofte er feil, med organisasjoner som er baserer seg på tvetydige eller uklare samtykkemekanismer som ikke oppfyller forordningens standarder for informert og fritt samtykke. Det er også en generell mangel på bevissthet blant enkeltpersoner om deres rettigheter og organisasjoner unnlater ofte å legge til rette for utøvelse av registrertes rettigheter på en betimelig og transparent måte.

Rapporten inneholder også anbefalinger for forbedringer. For det første må tilsynsmyndighetene styrke håndhevingsarbeidet og avskrekke fremtidige brudd gjennom ileggelse av bøter og sanksjoner. I tillegg bør organisasjoner prioritere investeringer i robuste sikkerhetstiltak, inkludert kryptering, tilgangskontroller og regelmessige sikkerhetsrevisjoner. Organisasjoner må prioritere åpenhet og klarhet i deres databehandlingspraksis, gi enkeltpersoner klar og tilgjengelig informasjon om hvordan deres personopplysninger samles inn, brukes og deles, og sikre bedre samtykkemekanismer. Rapporten understreker at det bør gjøres tiltak for å øke bevisstheten blant enkeltpersoner om deres rettigheter og gi dem mulighet til større kontroll over sine personopplysninger gjennom utøvelse av rettigheter.

Rapporten understreker et presserende behov for samordnet innsats fra både tilsynsmyndigheter, organisasjoner og enkeltpersoner for å fremme en kultur for etterlevelse og å opprettholde enkeltpersoners grunnleggende rett til personvern.

Rapporten finner du her

https://noyb.eu/sites/default/files/2024-01/GDPR_a%20culture%20of%20non-compliance_2.pdf

KOMMENDE MØTER

| 14. mars 14.00 – 16.00 | Digitalt nettverksmøte |

Se hele oversikten over kommende aktiviteter i nettverket her.

SISTE ORD

Du får dette nyhetsbrevet som medlem av tilt.works PrivacyTech-nettverk eller fordi du har tegnet et eget abonnement. Du kan oppdatere din profil her.

Snyltekapitalismen

Schibsted og 31 andre europeiske mediehus har saksøkt Google.

Det kommer som enda et av en lang, lang rekke søksmål mot de internasjonale IT-gigantene.

Jeg syns det er høyst betimelig.

Google er en av et lite antall aktører som er blitt mektige og superrike ved å snylte på andres verdiskapning.

To inntektskilder

Media har tradisjonelt levd av innhold, og det har de skapt inntekter fra ved at den som bruker innholdet betaler for bruken, og ved at annonsører betaler for oppmerksomhet fra de samme brukerne.

Før internett og web stod papiret i en luksuriøs særstilling. Verdien av annonseflatene var svært høy. Mediene tjente svært gode penger.

Da nettavisene kom, endret det seg. Verdien av en annonse ble synliggjort, og det var ikke alltid lett å forsvare investeringen. Annonsørene ble mer bevisste hvordan de brukte pengene.

Google og andre annonsenettverk etablerte seg som et mellomledd mellom annonsører og potensielle kunder.

På den måten ble enorme verdier omfordelt. De 22 milliarder de 32 europeiske mediene mener de fortjener i erstatning er antagelig bare smuler i forhold til hvilket omsetningstap de faktisk har lidd.

Portvoktere

Når det er sagt, er det også liten tvil om at mye av tapet er fra oppblåste inntekter de selv har hatt i egenskap av å være “portvoktere” for virksomheter som ønsker seg kunder. De var selv i praksis lokale og nasjonale monopoler som beriket seg på samme måte de nå anklager Google for.

Greit nok. La tyv fange tyv.

Den verdiøkningen Google har gitt annonsører i form av målrettede salgsbudskap er reell, og antagelig positiv i det store bildet, hvis man ikke henger seg opp i medienes stadig trangere økonomi.

Like fullt er det betenkelig faktum at Google, Facebook og noen andre store aktører lever utelukkende av verdier skapt av andre.

De er barn av den nye kapitalismen: Snyltekapitalismen. De fortjener motstand, og jeg ønsker de europeiske mediehusene lykke til.

Men jeg skulle gjerne sett at de store digitale selskapene ble sterkere utfordret på andre områder også. Viktigere områder.

Våre data

Et område er den skamløse måten de forsyner seg av våre data. Mine data er min eiendom, men den har ikke mye verdi i seg selv. Det er en dråpe vann i havet.

Men data fra noen milliarder mennesker, som hver seg eies av et individ, har en verdi. Det er selve havet.

I likhet med naturressurser som hav og vassdrag, er det en del av vår kollektive eiendom. Slik vi nå snakker om “lakseskatt” i form av en grunnrente for bruk av kollektive naturressurser, må vi begynne å snakke om en grunnrente på fellesskapets data.

I mangel av regulering har IT-gigantene kunnet spørre hver enkelt eier av “vanndråpene” om de vil bytte den mot litt enkel moro, og på den måten fått tilgang på hele havet.

Velferdssamfunnet

Et annet område som i svært liten grad er adressert ennå er verdien av arbeidet vi ikke lenger utfører fordi det utføres av en algoritme i Silicon Valley.

Skattlegging av data og verdier utvunnet av data genererer enorme mengder inntekt fra data de samler inn globalt. Utfordringen med å skattlegge disse inntektene ligger i den digitale økonomiens natur.

Vårt velferdssamfunn er fundert på skatt på inntekt. Inntekt er noe en arbeidstaker får fordi vedkommende skaper en verdi for arbeidsgiveren.

Når AI og annen teknologi sørger for at jeg gjør det samme arbeidet på 20 prosent av tiden, vil det som kostet arbeidsgiveren 100 kroner i lønn i går, koste 20 kroner i dag.

Det er lønnsomt for arbeidsgiveren, men for velferdsstaten betyr det at 80 prosent av inntektsskatten blir borte. Og siden verdiskapningen ikke skjer i Norge, skattlegges den heller ikke i Norge.

Da har snyltekapitalismen gått fra å suge blod fra små og store næringer og folk flest, til å utarme hele velferdssamfunnet vårt.

Ulikheter og uro

Så når jeg har sympati med Schibsted, Axel Springer og de andre, så er det ikke fordi jeg tenker at de er ofre som bør få oppreisning. Det er fordi det er viktig at utviklingen mot at stadig større verdier sluses inn i lommene til et fåtall superrike, internasjonale aktører utfordres.

Ulikheter skaper uro, konflikt og ofte krig. Jeg tror at mye av den uroen og splittelsen vi ser i verden i dag kan tilbakeføres til de stadig voksende ulikhetene mellom fattige og (super-)rike.

Det er ikke bærekraftig.

God tirsdag.

Opptak av møtet 15. feb 2024

På møtet i partnerskapet den 15. februar snakket vi om veien videre for tilt.work og for Partners in Tilt. Paal presenterte sine visjoner for tilt, mens Thomas presenterte tanker om hvordan modellen til PiT vil endre seg.

Farvel til alderismen. Eldre som livsbejaende, verdiskapende borgere

Den kommunale økonomi settes for tiden på prøve. Ordføreropprøret den 22. januar i år i Larvik samlet representanter for 120 skattefattige kommuner. Mange av disse kommunene får ikke nok inntekter til å kunne levere hverken lovpålagte eller forventede tjenester. Spesielt utfordrende er økende antall unge med rapportert dårligere mental helse, økende utenforskap og uføregrad samt kostbare spesialtiltak for utsatte barn.

read more…

Du skal få din lønn i vaffeljernet

Store deler av det norske samfunnsmaskineriet er basert på frivillighet. Tusenvis av frivillige legger igjen millioner av timer til glede for idrettslaget, politiske partier, menigheten, korpset, koret, speideren.

Den eneste kompensasjonen de får utover gleden ved å bidra til «saken» er at de kan spise så mange vafler de vil (bare de steker dem selv).

Råtnende røtter

Dugnadsånden er dypt rotfestet i norsk kultur, men mange opplever at røttene begynner å råtne. Fra mange hold hører vi historier om foreldre som ser seg og sine barn mer som kunder i idrettslaget enn medlemmer med felles ansvar for helheten.

Samtidig forventer mange foreninger og lag mye av sine medlemmer.

Kanskje denne ubalansen er utslagsgivende for en trend jeg mener å se nå: at foreninger, idrettslag og andre organisasjoner investerer mer i medlemmer som strekker seg lenger?

Frivillig lederutvikler

Jeg har, som en gjennomsnittlig norsk borger, engasjert meg mye i frivillighet gjennom årene, med tillitsverv i ulike organisasjoner både privat og profesjonelt. Jeg er også pro bono konsulent for Prospera, som deler ut verdifull konsulentbistand til verdige trengende organisasjoner.

Jeg er blitt glad i det frivillige Norge.

Så da jeg fikk anledning til å kombinere min erfaring med å vikle ut ledere med min begeistring for frivillighet i fjor, nølte jeg ikke. Jeg ble med i en pool av frivillige lederutviklere i Den norske turistforening (DNT).

Det er et av de morsomste oppdragene jeg har hatt, selv om lønna kun var kaffe, frukt og småkaker.

Engasjementet falt sammen med et lignende program som allerede var under utvikling i tilt.work for et stort idrettslag i Oslo.

I vinter har jeg derfor hatt gleden av å lose to kohorter frivillige ledere gjennom to versjoner av det femten timer lange programmet.

Ledelse avmystifisert

Felles for programmene er at de har en praktisk tilnærming til ledelse. Ledelse er ofte blitt opphøyd til noe nesten mystisk. Men ledelse er ikke hokus pokus. Ledelse er håndverk, teknikk, øvelse og refleksjon.

Gode ledere er gode ledere fordi de har en velfylt verktøykasse og har praktisk øvelse med verktøyene sine.

Det spesielle med å lede i frivilligheten er at det finnes få om noen ytre motivasjonsfaktorer. Alt handler om indre motivasjon, og den kommer i mange ulike former.

Det gir helt spesielle lederutfordringer. Der du som leder i andre sektorer har lønn, bonus og forfremmelse i ermet for å motivere til innsats, står du igjen med kun deg selv og din atferd som verktøy for motivasjon.

Den ultimate testen

Derfor er ledelse av frivillige den ultimate testen på ledelse.

Samtidig er indre motivasjon en sterk drivkraft også i mer formelle arbeidssituasjoner. Et eksempel er startups, hvor gründerne gjerne har «snublet» inn i ledelse fordi de forfulgte en lidenskap og en drøm om å endre bittelitt på verden. Folka de skal lede er gjerne motivert av det samme.

Jeg tror også det er gjenkjennbart for mange prosjektledere. De skal sikre at en gjeng med fremmede transformeres til et høytytende team. Da vil ofte «myke» lederferdigheter være et uvurderlig supplement til teknikkene de lærte på prosjektlederkurset.

Send stafettpinnen videre

Hvorfor forteller jeg deg dette en tirsdag morgen?

Du er smart, og ser at det er et element av salg i denne ukens Tirsdag morgen. Antagelig kjenner du en eller flere organisasjoner som kan være interessert i å styrke både organisasjon og medlemsmotivasjon ved å utvikle sine ledere.

Send stafettpinnen videre, eller ta kontakt med en mail. Hvis du leser dette i eposten din, kan du svare direkte.

God tirsdag.

Oppslagsbildet er AI-generert (ChatGPT)

Kunsten å skape engasjement i møter og på kurs

Kampen om oppmerksomhet er tøff. Vi er vant til å få servert informasjon i kvikke kutt og faller fort av om det som skjer på scene/skjermen ikke fenger.

Smak på denne: I en undersøkelse Wall Street Journal gjorde for noen år siden beskrev halvparten av topplederne presentasjonene de hører som “direkte søvndyssende” og 43 prosent som “fryktelig kjedelige”. Bare 7 prosent svarte “inspirerende”.

read more…

IT-jus nr. 1/24

Datatilsynet har kommet med en oversikt over nylig vedtatt regelverk fra EU. Der er AI Act, selvfølgelig. Men også

- Data Governance Act,

- Digital Markets Act,

- NIS 2 direktivet,

- General Product Safety Regulation,

- Digital Services Act,

- Critical Entities Resilience Directive

- Digital Operations Resilience Act (DORA).

Og ny lovgivning som ventes å komme om kort, er

- AI Liability Act,

- Consumer Credit Directive,

- European Health Data Space,

- European Media Freedom Act

og hele ni andre lover.

Fra ECJ fikk vi 32 avgjørelser om personvern i 2023. Et søk på EDPBs sider viser at de har publisert 117 dokumenter i 2023. Man kan bli svimmel av mindre! Heldigvis er ikke alt like viktig.

Uansett kan vi neppe bare forholde oss til GDPR fremover – personvernet sniker seg inn i mange andre lover også. For å finne relevant GDPR-materiale bruker jeg ofte GDPRhub som har en ganske fullstendig oversikt over europeiske avgjørelser, både fra domstoler og datatilsyn. Det er en fin og lett søkbar nettside som NOYB har tatt initiativ til.

Under er et knippe saker fra årsskiftet som har fanget min interesse. Jeg tar noen korte, enkle saker først, og så kommer noen litt mer juridiske ECJ-saker om erstatning for tort og svie til slutt.

I neste nettverksmøte skal vi ha en runde på hvordan det var å ha tilsyn for NAV samt en del om AIB TCF 2.2-rammeverket om cookies. Cookies er veldig i vinden og jeg vet at mange jobber hardt med å trimme tekst på hjemmesidene sine. Happy reading og riktig godt nytt personvernår!

Hilsen Eva

LOJALITETSPROGRAM

Slett kundeopplysninger i lojalitetsprogram

Det finske datatilsynet har kommet med en praktisk avgjørelse om lagringstid innen retail. Det dreier seg om Kesko, landets største retailkjede, og deres lojalitetsprogram.

De lagret kundeopplysninger og salgsopplysninger så lenge kundeforholdet varte. Tilsynet slo fast at koblingen til kundeforholdet kunne medføre lagring i hele kundens levetid og at dette var for lenge. Det ble også fremhevet at kjøpshistorikk kan brukes til å utlede særlige kategorier opplysninger. Kesko skulle også ha sørget for at kundene fikk velge hvor mye data om dem som ble samlet inn om dem.

Kesko slapp bot, men det er all grunn til å tro at lagringstid og sletting får oppmerksomhet fremover.

Saken er omtalt her https://gdprhub.eu/index.php?title=Tietosuojavaltuutetun_toimisto_(Finland)_-_3831/161/21&mtc=today

SAKER FRA DET DANSKE DATATILSYNET

Hva er tilstrekkelige sikkerhetstiltak?

Når man lurer på hvilke sikkerhetstiltak man må implementere, kan det være nyttig å se til en ny veileder fra det danske datatilsynet. Datatilsynet mottar ukentlig flere anmeldelser om brudd på persondatasikkerheten og mange handler om utilsiktet tilgang eller videreformidling av personopplysninger.

Tilsynet mener at bruddene kunne vært unngått med passende sikkerhetstiltak. Datatilsynet har derfor identifisert 10 typiske brudd og gir råd om relevante sikkerhetstiltak for å redusere risikoen for disse hendelsene.

Veiledningen henvender seg spesielt til ansatte med innflytelse på organisasjonens regler, prosedyrer, opplæring og tekniske konfigurasjoner for å beskytte mot brudd på persondatasikkerheten. Det vil antakelig være ganske nyttig lesning for mange. Med tanke på den oppmerksomhet NAV nylig har fått for sviktende adgangskontroll i Norge, er det interessant å se at første avvik de tar opp er nettopp “adgangsrettigheter etter behov”.

Du finner oversikten her

Mer om hva som er god tilgangskontroll

Det danske Datatilsynet har også gitt ut en veileder for nettopp tilgangsstyring. Tilsynet skriver at styring av brukernes tilganger er en helt grunnleggende del av informasjonssikkerhet, men at mange finner dette vanskelig. Manglende tilgangsstyring øker risikoen for brudd på persondatasikkerheten – alt fra ansattes uautoriserte innsyn og misbruk utført av tidligere ansatte, til målrettede hacker- og ransomware-angrep.

Veiledningen er tilgjengelig her

Vanskelig med samtykke på sykehus